Direction

- Responsable: Hédi TABIA (PR)

- Responsable-adjoint: Amine CHELLALI (MCF)

Domaine d’activité

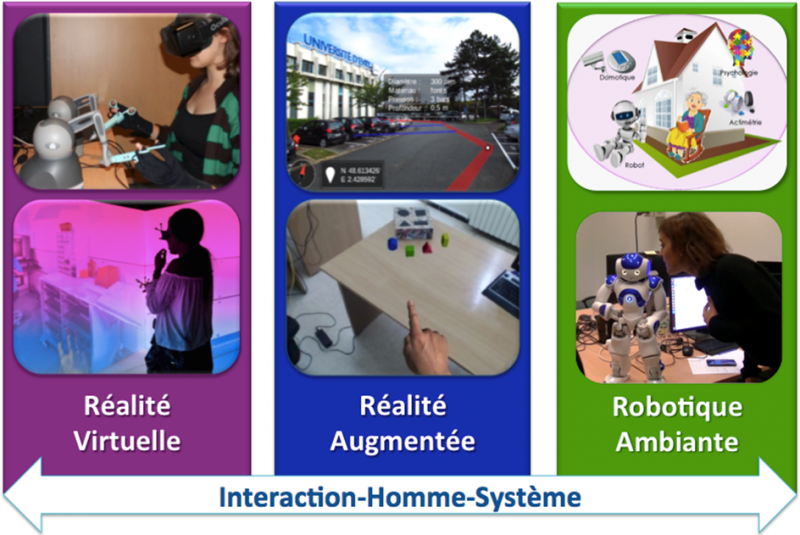

Les recherches de l’équipe IRA2 (Interaction, Réalité virtuelle & Augmentée, Robotique Ambiante) ont pour objectif d’améliorer les interactions entre des personnes et des systèmes complexes artificiels (virtuels, augmentés, robotisés, applications informatiques). La diversité, la complexité, l’imprévisibilité des tâches à réaliser et l’hétérogénéité technologique, rendent nécessaire la conception, la réalisation et l’évaluation d’outils numériques d’assistance adaptés.

Pour atteindre cet objectif, les activités sont organisées autour de deux axes de recherche :

- Axe 1 : Perception, Interprétation & Décision (PID)

- Axe 2 : Interaction-Homme-Système (IHS)

Axe 1: Perception, Interprétation & Décision (PID)

L’objectif de cet axe est d’apporter à ces systèmes artificiels des capacités :

1) de perception de l’environnement (réel ou virtuel), de capture des utilisateurs, et ce en temps réel et à partir de sources variées de données issues des capteurs embarqués, des objets communicants, des interfaces de RV/RA;

2) d’interprétation voire de compréhension des données perçues ainsi que des algorithmes d’adaptation dynamique à un contexte évolutif et d’aide à la décision.

Perception de l’environnement réel ou virtuel :

- Objectifs : Permettre au système artificiel d’améliorer, de compléter, de restaurer, de prédire la réalité en procurant des assistances sensorielles à un utilisateur (groupe d’utilisateurs) ou à un robot dans son monde réel (dans le cas de la réalité augmentée) ou virtuel (dans le cas de la simulation en réalité virtuelle).

- Problématique : Lever les verrous : 1) de la mise en conformité en temps réel des mondes réel et virtuel; 2) de détection, de localisation, de cartographie d’environnements et du suivi robuste multi capteurs de cibles (objets, utilisateurs ou robots);

- Approches : approches basées descripteurs, analyse/synthèse d’images basées modèles, SLAM basé sur l’ajustement de faisceaux et sur la modélisation planaire.

- Mots clés : Réalité augmentée, réalité virtuelle, calibration de capteurs, modélisation et recalage 3D, prédiction, appariement 2D/3D, suivi hybride robuste, localisation.

Interprétation & décision :

- Objectifs : Permettre au système artificiel d’analyser et d’interpréter les données reçues et de construire des algorithmes d’aide à la décision facilitant l’exploitation des données par un utilisateur (ou un groupe d’utilisateurs) ou par un robot.

- Problématique: Lever les verrous : 1) de l’adaptabilité de l’Interaction Homme-Machine en fonction du contexte; 2) de la reconnaissance de gestes et d’émotions par un robot; 3) de l’adaptation au contexte pour l’assistance ambiante et à la personne.

- Approches : Traitement et fusion de données hétérogènes, classification, coopération multi-agents, mécanismes de coalition et de négociation, modèles de présence.

- Mots clés : Réalité augmentée, réalité virtuelle, apprentissage automatique, context-aware, systèmes multi-agents, cobotique.

Axe 2: Interaction-Homme-Système (IHS)

L’objectif de cet axe est de formaliser des concepts et de développer des techniques d’interaction et de communication en réalité virtuelle, en réalité augmentée, ou en robotique qui soient multimodales et adaptées à l’humain dans son environnement (réel ou virtuel), mais également adaptées à un robot assistant évoluant dans son environnement. Ce dernier, peut être un espace intérieur (indoor) ou bien extérieur (outdoor).

Interaction en environnement réel augmenté ou virtuel :

- Objectifs : Proposer à l’utilisateur (ou groupe d’utilisateurs) des techniques d’interaction 3D (navigation, sélection, manipulation, contrôle d’application) qui soient naturelles et multimodales afin d’améliorer les performances des tâches et des utilisateurs (notamment en réduisant les courbes d’apprentissage et en assurant la cohérence multisensorielle).

- Problématique : Lever les verrous : 1) du maintien de la cohérence sensorielle dans l’espace et dans le temps entre l’action d’un utilisateur et la réaction des systèmes de RA/RV; 2) des limites des interfaces caractéristiques de RA/RV et les contraintes de la tâche ; 3) de l’amélioration de l’utilisabilité des interfaces et de la motivation des patients; 4) de la fidélité des interactions 3D dans les simulateurs virtuels; 5) de prototypage rapide d’applications de RA mobiles.

- Approches : Conception centrée sur l’utilisateur, approches basées sur les mécanismes d’adhésion/motivation (les théories de la motivation), mécanismes de guides virtuels, modèle du trèfle fonctionnel des collecticiels, modèles de présence, architecture basée composants.

- Mots clés : Réalité augmentée, réalité virtuelle, interaction 3D, interaction naturelle, interfaces tangibles, facteurs humains, travail collaboratif, architecture logicielle.

Interactions humain-Robot & cobotique :

- Objectifs : Permettre des interactions (distantes ou physiques) homme-robot qui soient naturelles et multimodales.

- Problématique: Lever les verrous : 1) de la téléopération en présence de délais; 2) de la reconnaissance de gestes et d’émotions par un robot; 3) de la malléabilité des systèmes collaboratifs homme-robot; 4) de la co-perception homme-robot (partage des sens et du savoir entre l’homme et le robot pour construire une perception mutuelle et augmentée)

- Approches : modélisation des interactions homme-robot, modèle de coprésence, apprentissage et adaptation aux changements (environnement/utilisateur).

- Mots clés : Interaction homme-robot, réalité augmentée, réalité virtuelle, téléopération, apprentissage, cobotique.

Domaines d’application : Santé & Industrie

- Médecine personnalisée

- Mobilité intelligente durable et coopérative

Actualités de l’équipe IRA2

- 01/2021 : La newletter de International Society for Virtual Rehabilitation met en avant les travaux sur le projet ARRoW CP présentés par Anne-Laure GUINET lors du World Congress for Neurorehabilitation !

- 11/2020 : Le projet ANR Jeune Chercheur intitulé : « Show-me: Virtual reality mentee-mentor multimodal collaboration for surgical skills training » dont Amine CHELLALI est porteur a été accepté par l’ANR !

- 10/2020 : Le labo ratoire IBISC et l’UFR Sciences et Technologies de l’Université d’Évry contribuent à la création de l’oeuvre « The punishment » de l’artiste Filipe VILAS-BOAS

- 06/2020 : COVID-19: Genopole met à l’honneur le travail commun du laboratoire IBISC et du CHSF, qui se sont s’associés pour créer une application mettant en œuvre deux calculatrices pour une prescription à risque minimum de médicaments non conventionnels.

- 12/12/2019 : Ludovic David soutient sa thèse de doctorat, 14h: « Conception et évaluation d’un système de réalité virtuelle pour l’assistance à l’auto-rééducation motrice du membre supérieur post-AVC »

- 28/11/2019: Anne-Laure GUINET (doctorante Université d’Évry, laboratoire IBISC/Fondation Poidatz) est lauréate du prix ESSI du meilleur poster attribué lors du colloque Évry-Sénart Sciences et Innovation ESSI du jeudi 28/11/2019 intitulé: : « Réalité Virtuelle et Réalité Augmentée Comment bouleversent-elles la formation? »

- 02/10/2019: Simulation par la Réalité Virtuelle et formation opératoire: le Genopole met en avant IBISC et la plate-forme EVR@ !

- 12/07/2019: Fida Ben Abdallah soutient sa thèse de doctorat le vendredi 12 juillet 2019: « Modélisation et commande d’un robot parallèle à câbles suspendu à un dirigeable gros porteur »

- 27/06/2019: IRA2 hors les murs au C-19 ENSIIE

- 24/06/2019: [13-14 IRA2]Séminaire de Anne-Laure Guinet (Doctorante CIFRE IBISC IRA2/Institut Poidatz) le lundi 24 juin 2019: “ARRoW-CP : Retours sensoriels multimodaux en réalité mixte pour la rééducation à la marche post-chirurgie chez des enfants atteints de paralysie cérébrale”

- 16/06/2019: Séminaire de Samir Otmane (responsable de l’équipe IRA2, laboratoire IBISC) le dimanche 16 juin 2019, au CDTA, ALger: “Interaction, Réalité virtuelle & Augmentée, Robotique Ambiante : Bilan et perspectives de recherche et de l’écho-système d’IRA2.”

- 21/03/2019: La plate-forme EVR@ participe à la semaine de l’Industrie 2019

- 03/03/2019: L’Université d’Evry Paris-Saclay met en lumière le travail de IBISC dans le domaine de la santé!

- 27/02/2019: Partenariat sur une thèse d’un employé du Groupe SEDNA France

- 26/02/2019: Contrat CIFRE, Fondation Poidatz

- 20/02/2019: Insaf Ajili a reçu le prix du « Best Paper Award » dans la conférence ICIAP’2018 !

- 10/12/2018: Jean-Yves Didier soutient son HDR – Architectures pour les logiciels de réalité augmentée : des concepts aux applications

- 03/12/2018: Insaf Ajili soutient sa thèse de doctorat. « Reconnaissance des gestes expressifs inspirée du modèle LMA pour une interaction naturelle Homme-Robot »

- du 29/10/2018 au 31/10/2018: Journées de la Réalité Virtuelle J-RV 2018