Sujet : «Construire un modèle d’interactions formateur-apprenant lors du transfert de compétences médicales »

Mots clé : Réalité Virtuelle, Interactions multimodales, Interactions collaboratives, compagnonnage, formation médicale

Contexte

Ce stage s’inscrit dans les domaines de l’interaction homme machine et de la réalité virtuelle (RV) appliqués à la formation médicale. Il vise à construire un modèle d’interactions multimodales et collaboratives pour concevoir des environnements virtuels permettant à un formateur d’enseigner des gestes médicaux techniques. Il sera réalisé dans le cadre du projet Show-me (Virtual reality mentee-mentor multimodal collaboration for surgical skills training) financé par l’Agence Nationale de la Recherche (ANR) en collaboration avec le LabForSIMS, le CHSF, le LISN et le LS2N.

Problématique

Les internes en médecine sont traditionnellement formés sur la base du modèle de compagnonnage en s’entrainant sur les patients au cours des stages hospitaliers encadrés par des experts. Cependant, pour des raisons éthiques et de sécurité des patients, comme conclut par le rapport de la Haute Autorité de Santé 2012 « jamais la première fois sur le patient », le développement de nouveaux paradigmes de formation médicale innovants basés sur la simulation devient un nécessité et une urgence. Pour assurer cette transition pédagogique, les simulateurs basés sur les technologies de la réalité virtuelle peuvent jouer un rôle important. Cependant, leur développement reste complexe et potentiellement coûteux. Il est donc nécessaire de concentrer leur conception et leur utilisation sur les besoins réels de formation des professionnels de santé.

L’objectif du projet ANR Show-Me est de concevoir de nouvelles techniques d’interaction multimodales et collaboratives et des interfaces utilisateurs innovantes permettant à un tuteur expert de partager ses compétences, de superviser et de guider un apprenant à travers un environnement de formation collaboratif et multimodal en réalité virtuelle pour un meilleur transfert des compétences médicales techniques. Cela permettra de garder le formateur dans la boucle et de profiter ainsi des avantages du modèle de compagnonnage mais dans un environnement plus sûr.

L’objectif du présent stage est de réaliser des études sur le terrain afin de mieux comprendre les interactions apprenantformateur dans les situations de formations actuelles. Ces études permettront de construire un modèle d’interaction pour guider la conception d’environnements virtuels collaboratifs et multimodaux pour la formation médicale par compagnonnage. Ce stage sera en soutien d’un travail de thèse de doctorat en cours.

Travail à réaliser

- Réaliser une étude de l’état de l’art du domaine,

- Participer à la réalisation des études sur le terrain dans les blocs opératoires et les centres de formation (facilitées par les partenaires du projet) afin de mieux comprendre les situations de formation actuelles,

- Construire un premier modèle d’interactions multimodales et collaboratives susceptible de supporter la formation médicale en telementoring dans un environnement virtuel,

- Concevoir des techniques d’interaction se basant sur ce modèle,

- Implémenter les techniques dans les environnements virtuels déjà développés au sein du laboratoire IBISC et évaluer leur pertinence,

- Publier les résultats dans une conférence nationale ou internationale.

Compétences et qualités requises

Niveau M2 ou dernière année en école d’ingénieur, bonne maîtrise de la conception/programmation (si possible Unity/C#), connaissance des interactions multimodales, de la réalité virtuelle, de la méthodologie de conception centrée utilisateur, avoir un goût pour la recherche, le travail d’équipe et les échanges pluridisciplinaires.

Conditions du stage

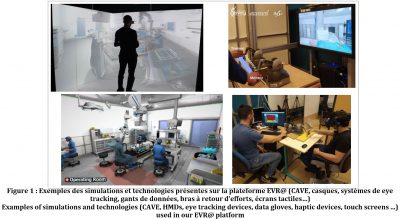

Le stage se déroulera au laboratoire IBISC et sera en soutien d’un travail de thèse en cours. Une plateforme expérimentale (plateforme EVR@) et des EV pour la simulation chirurgicale sont mis à disposition. Le stagiaire sera également en interaction avec les autres doctorants et stagiaires de l’équipe. Il/elle sera également convié à participer à certaines réunions avec les cliniciens et à faire des observations sur le terrain dans les hôpitaux et les centres de formation médicale partenaires en compagnie de la doctorante.

Durée : 6 mois (entre février et octobre 2022, selon disponibilités)

Gratification minimale légale (environ 560€/mois)

Contact

Merci de faire parvenir une lettre de motivation, un CV, les relevés de notes du Master 1 et/ou Master 2, et deux lettres de recommandations recherche à :

Amine CHELLALI Laboratoire IBISC EA 4526 – Equipe IRA2

01 69 47 75 33 Bâtiment Pelvoux 2, IUP

40, Rue du Pelvoux https://www.ibisc.univ-evry.fr Courcouronnes 91020 EVRY

Title: Building a model of mentor-mentee interactions during medical skills transfer

Keywords : Virtual Reality, Multimodal interactions, Collaborative interactions, mentoring, medical training

Context

This internship is in the fields of human machine interaction and virtual reality (VR) applied to medical training. It aims to build a model of multimodal and collaborative interactions to design virtual environments allowing an instructor to teach technical medical skills to a trainee. This is part of the Show-me project (Virtual reality mentee-mentor multimodal collaboration for surgical skills training) funded by the National Research Agency (ANR) in collaboration with LabForSIMS, CHSF, LISN and LS2N.

Research problematic

Medical interns are traditionally trained through the companionship model by practicing on real patients during hospital internships supervised by experts. However, due to clear ethical and patient safety issues, as concluded by the 2012 Haute Autorité de Santé report « never the first time on the patient », the development of new innovative medical training paradigms based on simulation becomes a necessity and an emergency. To support this transition, simulators based on virtual reality technologies can play an important role. However, their development remains complex and potentially expensive. It is therefore necessary to focus their design and use on the real training needs of healthcare professionals.

The ANR Show-Me project aims to design multimodal and collaborative interaction techniques and innovative user interfaces allowing an expert tutor to share his skills, supervise and guide a learner through a collaborative training environment and multimodal in virtual reality for a better transfer of technical medical skills. This permits to keep the mentor in the loop and thus to benefit from the advantages of the companionship model but in a safer environment.

The objective of this internship is to carry out field studies in order to better understand current learner-teacher interactions. These studies will permit to build an interaction model to guide the design of collaborative and multimodal virtual environments for medical training through companionship. This internship will be in support of an ongoing PhD thesis work.

Work description

- Conducting a literature review of the research field,

- Contributing to carrying out field studies to better understand current training methods in operating theaters and training centers (facilitated by project partners)

- Defining a first model of multimodal and collaborative interactions capable of supporting medical training through telementoring in a virtual environment,

- Design interaction techniques based on this model,

- Implementing the techniques in the virtual environments already developed within the IBISC laboratory and assess their relevance,

- Publishing the results in a national or an international conference.

Qualifications

Master 2 or last year in an engineering school, good experience with HCI, UI design and programming (Unity 3D/C#), knowledge in multimodal interactions, virtual reality, user-centered design, high interest in research, teamwork and multidisciplinary work.

Work conditions

The work will be carried out within the IRA² team at the IBISC Lab and will be in support of an ongoing PhD thesis work. An experimental platform (EVR@) and existing virtual environments for surgical simulation will be available. The trainee will be in constant interaction with the team’s PhD students and other interns. He/she will also be invited to participate in research meetings with the project partners and to conduct field studies in the partner hospitals and training centers.

Duration: 6 months (ranging from Feb to Oct 2022)

Compensation: minimum legal compensation (around 560€/month)

Contact

Please send your application letter, a CV, two research recommendation letters, and Master transcripts (M1/M2) to:

Amine CHELLALI Laboratoire IBISC EA 4526 – Equipe IRA2

01 69 47 75 33 Bâtiment Pelvoux 2, IUP

40, Rue du Pelvoux https://www.ibisc.univ-evry.fr Courcouronnes 91020 EVRY

References

- Chellali A, Mentis H, Miller A, Ahn W, Arikatla V, Sankaranarayanan G, Schwaitzberg S, Cao C (2016) Achieving Interface and Environment Fidelity in the Virtual Basic Laparoscopic Surgical Trainer. IJHCS 96: 22–37

- Chellali A, Dumas C, Milleville-Pennel I (2012) Haptic communication to support biopsy procedures learning in virtual environments. Presence: Teleoperators and Virtual Environments 21(4): 470–489

- Mentis H, Chellali A, Schwaitzberg S (2014) Learning to see the body: supporting instructional practices in laparoscopic surgical procedures. Proceedings of the CHI Conference on Human Factors in Computing Systems, pp 2113–2122

- Mentis HM, Feng Y, Semsar A, Ponsky TA (2020) Remotely Shaping the View in Surgical Telementoring. Proceedings of the CHI Conference on Human Factors in Computing Systems, pp 1–14

- Le Chénéchal M, Duval T, Gouranton V, Royan J, Arnaldi B (2019) Help! I Need a Remote Guide in My Mixed Reality Collaborative Environment. Frontiers in Robotics and AI 6: 106

- Chengyuan, Edgar, Maria, et al. (2020) How About the Mentor? Effective Workspace Visualization in AR Telementoring. 2020 IEEE Conference on Virtual Reality and 3D User Interfaces (VR)

- Lee G, Kang H, Lee J, Han J (2020) A User Study on View-sharing Techniques for One-to-Many Mixed Reality Collaborations. 2020 IEEE Conference on Virtual Reality and 3D User Interfaces (VR)

- Moll J, Frid E (2017) Using eye-tracking to study the effect of haptic feedback on visual focus during collaborative object managing in a multimodal virtual interface. SweCog 2017, October 26–27, Uppsala, Sweden, pp 49–51

- Moll J, Pysander ELS, Eklundh KS, Hellström SO (2014) The effects of audio and haptic feedback on collaborative scanning and placing. Interacting with computers 26: 177–195

- Wang J, Chellali A, Cao CGL (2016) Haptic communication in collaborative virtual environments. Human factors 58: 496–508

- Ricca A, Chellali A, Otmane S (2020) Comparing touch-based and head-tracking navigation techniques in a virtual reality biopsy simulator. Virtual Reality, https://doi.org/10.1007/s10055-020-00445-7

- Ricca, A. Chellali, A., Otmane, S. (2020) Influence of hand visualization on tool-based motor skills training in an immersive VR simulator. In the proceedings of IEEE International Symposium on Mixed and Augmented Reality (ISMAR), pp 339-347

- Ricca, A. Chellali, A., Otmane, S. (2021) The influence of hand visualization in tool-based motor-skills training, a longitudinal study. In the proceedings of the 2021 IEEE Virtual Reality and 3D User Interfaces (VR 2021), pp 103-112

- Date de l’appel : 06/12/2021

- Statut de l’appel : Non pourvu

- Contact coté IBISC : Amine CHELLALI (MCF Univ. Évry, IBISC équipe IRA2) amineDOTchellaliATuniv-evryDOTfr

- Sujet de stage niveau Master 2 (format PDF)

- Web équipe IRA2

- Plate-forme EVR@